L’intelligence artificielle (IA) est un enjeu technologique mondial. Elle intéresse tous les secteurs de la société, et est présente dans des domaines spécifiques comme la recherche, la défense, la santé, la formation… et aussi dans notre quotidien, avec de nombreuses applications intelligentes et personnalisées pour nos activités professionnelles et privées. L’intelligence artificielle est une révolution qui participe à augmenter les capacités humaines, mais en même temps elle soulève de nombreuses problématiques liées au développement et aux usages de systèmes algorithmiques complexes. Cet article explique en quoi il est primordial de mettre en place un cadre réglementaire pour avoir un système d’intelligence artificielle éthique, équitable et responsable.

En quoi l’IA responsable est-elle importante ?

Avec l’IA générative, nous déléguons beaucoup de tâches, de raisonnements et de décisions de plus en plus critiques à des machines. Or, dans cette exploration des possibles portée par un environnement technologique changeant, la question d’une IA éthique en phase avec les valeurs et les attentes de la société est centrale. L’intelligence artificielle est un vecteur de progrès indiscutable, mais le développement et l’intervention de cette technologie numérique doivent tenir compte de tous les impacts sociétaux potentiels en matière de partialité, de transparence et de protection de la vie privée.

Voici les principaux défis à relever pour transformer une IA en intelligence artificielle éthique :

- Le manque de transparence des systèmes numériques algorithmiques. Les décisions prises par les IA sont opaques (la plupart des algorithmes ne sont pas en open source), ce qui pose de réels problèmes en matière de responsabilité et d’éthique.

- La reproduction de biais et discriminations présents dans les jeux de données sur lesquels les algorithmes d’IA sont entraînés.

- La production d’informations trompeuses en format texte, son, image ou vidéo.

- La remise en cause du droit à la vie privée et à la protection des données personnelles et confidentielles en raison de la collecte de données massives par l’intelligence artificielle, notamment via les dispositifs de surveillance (reconnaissance faciale en temps réel avec la vidéosurveillance algorithmique).

- Les problèmes liés aux limites d’autonomie de systèmes numériques dotés d’une intelligence artificielle et aux moyens de contrôle.

La solution pour une IA éthique, sûre, fiable et responsable repose sur la mise en œuvre d’un cadre réglementaire accepté par tous les acteurs (concepteurs, professionnels, utilisateurs).

Établir des principes pour une IA éthique

Au regard de ces risques, il est donc important de poser un ensemble de principes universels s’appliquant à tous les concepteurs et déployeurs d’IA. L’idée est de créer un environnement fiable et robuste, propice à l’innovation, et d’encadrer le développement et l’usage d’une IA éthique. L’Europe est particulièrement active et volontaire sur le sujet. Elle est animée par la volonté de « faire en sorte que l’IA soit centrée sur l’humain et digne de confiance [1] ».

Comme nous allons le voir, les principes et valeurs d’une intelligence artificielle éthique concernent toutes les strates de cette technologie.

Modèles de fondation et IA générative

L’IA générative est capable de générer des contenus originaux (texte, image, audio, vidéo, lignes de code…) en réponse à une requête utilisateur. Son fonctionnement repose sur un modèle de fondation, un modèle d’apprentissage profond qui peut être exploité dans différents types de systèmes numériques embarquant une IA générative. À titre d’exemple, pour une IA générative de contenus textuels, les modèles de fondation les plus répandus sont les grands modèles de langage (LLM) représenté par Open AI avec notamment Chat GPT (Generative Pre-trained Transformer) et DALL-E (générateur d’image à partir de texte) mais aussi Claude. Ces algorithmes sont entraînés sur des masses de données afin de comprendre et générer des textes en langage naturel.

L’éthique, mais aussi les performances et la fiabilité d’un modèle de fondation dépendent de son architecture et de la qualité des données qui l’approvisionnent. Un modèle de fondation entraîné sur un corpus de données fortement marquées par des stéréotypes, des données erronées, ou encore des données sensibles ou inappropriées, reproduira mécaniquement ces biais et donnera des contenus nuisibles.

Pour qu’un modèle de fondation soit éthique, il faut que les données soient :

- Représentatives en termes de diversité et de pluralité, pour permettre une compréhension large et neutre du monde dans lequel ce système numérique prend place.

- Fiables et régulièrement contrôlées, pour que le modèle repose sur des données cohérentes et justes.

- Équilibrées, afin d’éviter la sur ou sous-représentation de groupes, d’opinions…

- En nombre suffisant et actuelles.

Enfin, les données exploitées doivent respecter les réglementations relatives à la protection des données (RGPD), au respect de la confidentialité et au consentement, et ne pas être sous copyright.

Singularité technologique

La singularité technologique est une théorie selon laquelle les systèmes d’intelligence artificielle finiront par avoir des capacités cognitives supérieures aux capacités humaines, avec en plus la faculté de s’améliorer de manière autonome. Le terme singularité se réfère à des concepts mathématiques désignant un stade où le modèle existant s’effondre. Cette théorie prédit l’évolution rapide et non contrôlée de l’IA, donnant naissance à des systèmes autonomes, capables d’innovations échappant à la compréhension et au contrôle humain.

Le cadre réglementaire d’une IA éthique est la solution pour préserver nos sociétés des risques d’une croissance technologique incontrôlée et irréversible, entraînant des bouleversements profonds dans la civilisation humaine et dans les systèmes de valeur.

Impact de l’IA sur les emplois

Les systèmes numériques basés sur l’IA offrent un gain de productivité important grâce à l’automatisation des tâches les plus répétitives et mécaniques. Le FMI considère qu’elle va affecter 60 % des emplois dans les pays économiquement avancés [2]. Et pour la revue de l’Institut Polytechnique de Paris, ce sont près de 75 millions d’emplois dans le monde qui pourraient être automatisés [3].

L’article met également en évidence l’impact du déploiement de l’intelligence artificielle :

- Sur les emplois de bureau peu et moyennement qualifiés, avec plus de 80 % des tâches qui pourraient être réalisées par des bots.

- Sur l’emploi des femmes, deux fois plus présentes dans ces postes administratifs.

- Comme source d’inégalité avec les pays à faibles revenus, qui n’auront pas accès à ces technologies vancées.

Suivant leurs domaines d’application, les innovations technologiques ont toujours eu des répercussions importantes. Avec l’IA, les effets sur les sociétés et l’emploi sont sans commune mesure. L’automatisation par les systèmes numériques d’intelligence générative remet en cause la pérennité de certaines catégories d’emplois et accélère l’obsolescence de nombreuses compétences.

Mais le déploiement de l’IA peut être aussi synonyme de prospérité collective, d’amélioration de la qualité du travail, et participer à la réduction des inégalités. Afin de préserver la place centrale de l’humain dans la création de richesses durables, il faut mettre en œuvre une gouvernance de l’intelligence artificielle éthique axée sur la formation à de nouveaux métiers et l’acquisition de nouvelles compétences.

Confidentialité

Le respect de la vie privée et la protection des données confidentielles font partie des principes fondateurs de l’IA éthique. Même si son développement repose sur l’exploitation de données massives, l’intelligence artificielle doit protéger les données personnelles des individus en adoptant des mécanismes similaires à ceux du RGPD [4], où chaque individu doit pouvoir exprimer son consentement de façon libre et éclairée et accéder à tout moment à ses informations personnelles pour les modifier, voire les supprimer.

Préjugés et discrimination

La conception et le développement d’un système numérique basé sur une IA éthique doivent garantir :

- L’équité et la non-discrimination, en mettant en place des procédures de contrôle des algorithmes et des données utilisées pour l’entraînement des modèles de fondation.

- L’absence de malveillance. Les IA ne doivent pas produire de contenus néfastes pour les personnes, la société ou l’environnement.

- L’inclusivité. Une IA éthique doit respecter la diversité des points de vue et des sociétés de manière neutre et équilibrée.

Responsabilité et transparence

La responsabilité et la transparence figurent aussi parmi les principes d’une IA éthique. La responsabilité veut que la conception, le développement, le déploiement et l’utilisation de ces technologies soient alignés sur les valeurs des parties prenantes, les normes juridiques et les principes éthiques.

La transparence concerne le fonctionnement des algorithmes, afin de faciliter les contrôles et la compréhension des utilisateurs.

Comment établir une IA éthique

La gouvernance

La gouvernance est la première brique d’une intelligence artificielle éthique. Cette méthode de gestion est basée sur des mécanismes de surveillance des phases de conception des algorithmes et d’apprentissage profond pour corriger les éventuels biais : malveillance, violation des données confidentielles, discrimination, surreprésentation d’opinions, manque de diversité… La gouvernance détermine un cadre équilibré, indispensable à l’émergence d’une IA éthique et responsable.

Les domaines d’action d’une IA éthique

L’IA éthique peut être mise en œuvre dans 10 domaines :

- La santé,

- La finance,

- La logistique et les transports,

- La recherche, l’éducation et la formation (avec des outils comme une ia pour créer des formations),

- L’énergie et l’environnement,

- Les médias et le divertissement,

- Le commerce et le marketing,

- L’industrie,

- La gestion de projet,

- Le recrutement et la gestion des ressources humaines et des compétences (IA pédagogique).

Promouvoir des pratiques responsables en matière d’IA

La promotion en entreprise de pratiques responsables en matière d’intelligence artificielle, basée sur des valeurs centrées sur le respect des droits humains, l’éthique et la transparence, est indispensable. Elle assure le développement de technologies améliorant nos capacités et notre performance dans un cadre éthique résilient en termes d’impartialité, de transparence et de protection de la vie privée.

Rôle déterminant de l’IA dans les domaines de l’apprentissage et de la formation

La contribution de l’IA à la formation est déterminante. Les entreprises et les organismes de formation profitent de la puissance et de l’agilité des systèmes numériques intelligents pour :

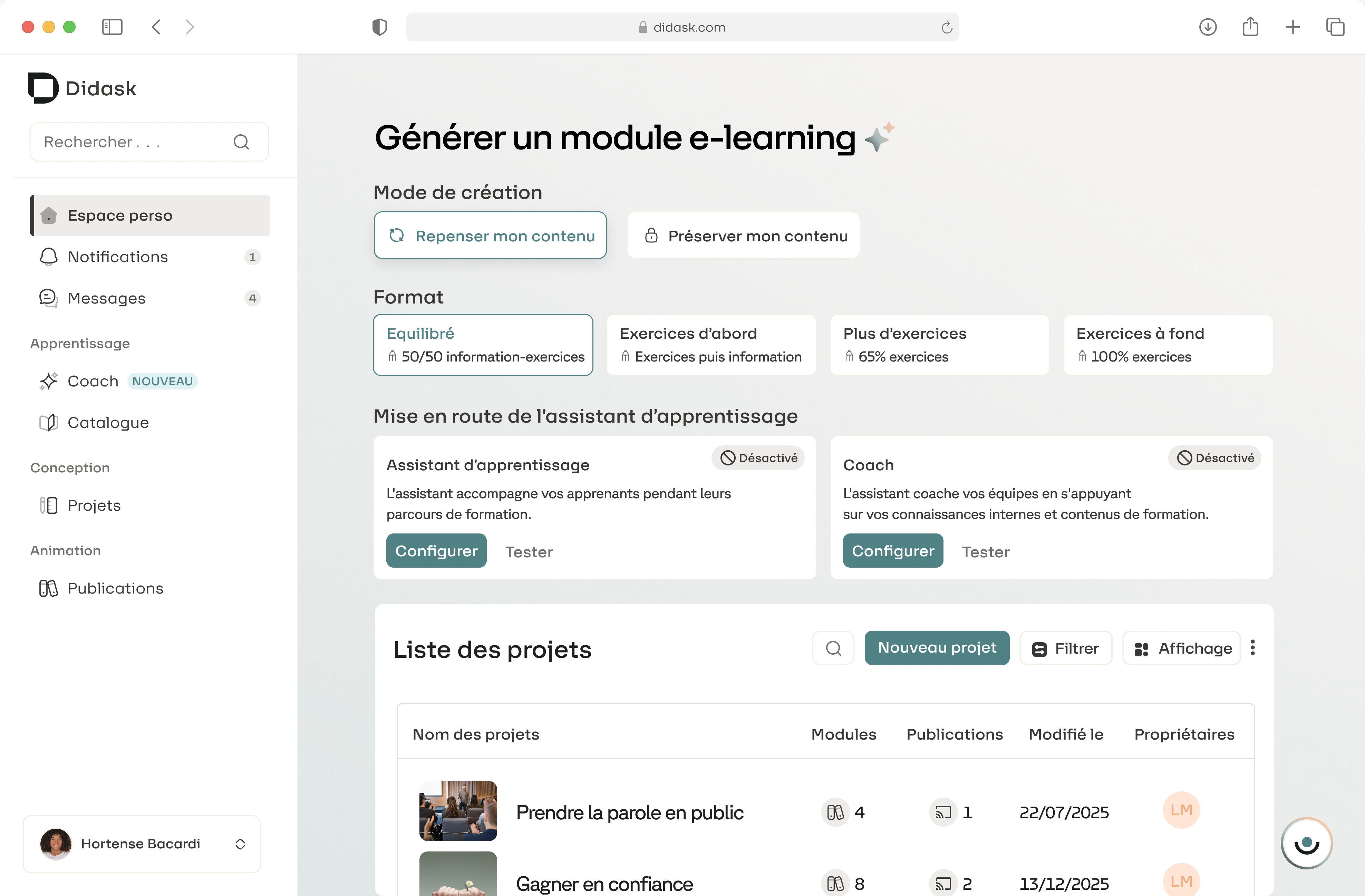

- Adapter les cursus de formation. Les plateformes LMS développées à partir d’une IA éthique intègrent des modules puissants comme l’adaptive learning (apprentissage adaptatif), facilitant la personnalisation des parcours d’acquisition de compétences.

- Produire des contenus personnalisés qui répondent aux exigences pédagogiques et aux besoins des collaborateurs. L’outil auteur est une fonctionnalité d’intelligence artificielle qui automatise la création, l’organisation et la publication de contenus pédagogiques interactifs sur mesure.

Ce système numérique intelligent optimise la personnalisation des offres de formation, pour plus d’efficacité, et prépare les collaborateurs à un environnement augmenté par l’IA plus immersif. En devenant acteurs de leur formation, les apprenants s’engagent pleinement dans la réussite de leur programme. C’est aussi un retour sur investissement concret et plus encadré pour l’entreprise.

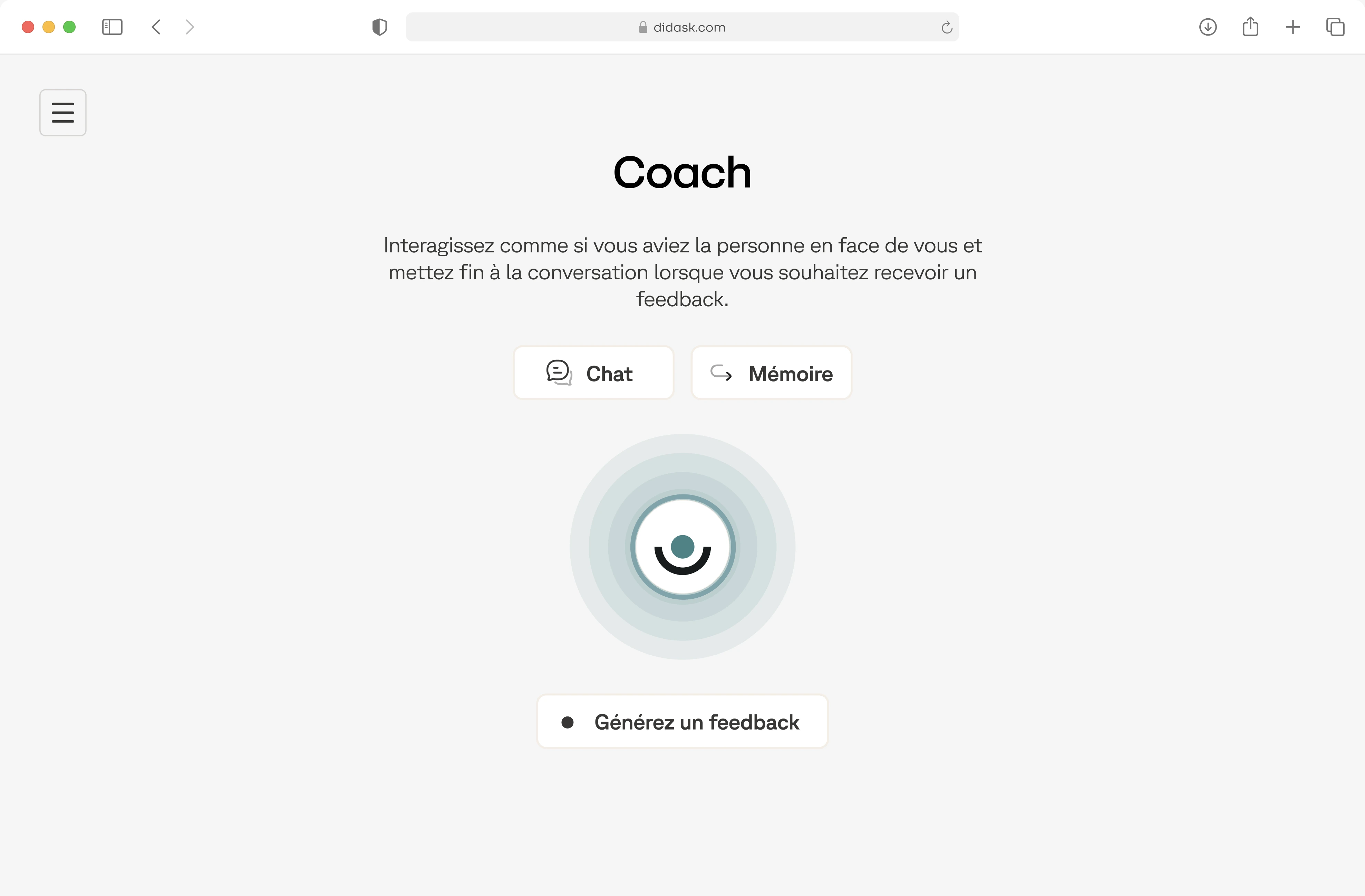

L’utilisation d’assistant IA de formation avec l’outil lms (Learning Management System) Didask personnalise l’expérience d’apprentissage et la rend plus efficace grâce à une méthode basée sur les sciences cognitives. L’IA pédagogique Didask s’inscrit dans une démarche éthique forte et respectueuse des valeurs d’équité, de transparence, de responsabilité et de protection de la vie privée. Cet outil technologique ne remplace pas l’humain ; il permet simplement de démocratiser l’accès à une pédagogie de qualité et de favoriser un enseignement sur mesure, pour une efficacité accrue.

La plateforme d’intelligence artificielle pédagogique Didask est éthique car :

- Elle est supervisée par des humains et elle les place au cœur de l’apprentissage.

- Le développement des parcours pédagogiques s’appuie sur les principes des sciences cognitives, permettant d’offrir des contenus adaptés à une grande diversité d’apprenants et d’accompagner leur montée en compétences.

- Elle rend l’accès à la formation équitable grâce à la création agile de parcours sur mesure.

- Elle respecte les normes RGPD (règlement général sur la protection des données), garantissant une protection maximale des informations des utilisateurs. De plus, elle met en place des mesures strictes pour la protection et la confidentialité des données collectées, pour une utilisation sécurisée des outils de e-learning Didask.

Sources :

[1] https://digital-strategy.ec.europa.eu/fr/policies/european-approach-artificial-intelligence

.png)