Mesurer l'impact d'une formation, c'est un exercice que tout le monde prétend faire. Questionnaires de satisfaction en fin de parcours, taux de completion, auto-évaluations... Les indicateurs ne manquent pas.

Pourtant, ces métriques reflètent-elles vraiment la montée en compétences des apprenants ? Spoiler : pas vraiment.

Chez Didask, nous avons mené une étude d'impact comparative pour mesurer ce qui compte vraiment : la capacité des apprenants à mobiliser leurs nouvelles compétences en situation réelle. Les résultats nous ont révélé trois enseignements contre-intuitifs qui remettent en question bien des certitudes sur la formation en ligne.

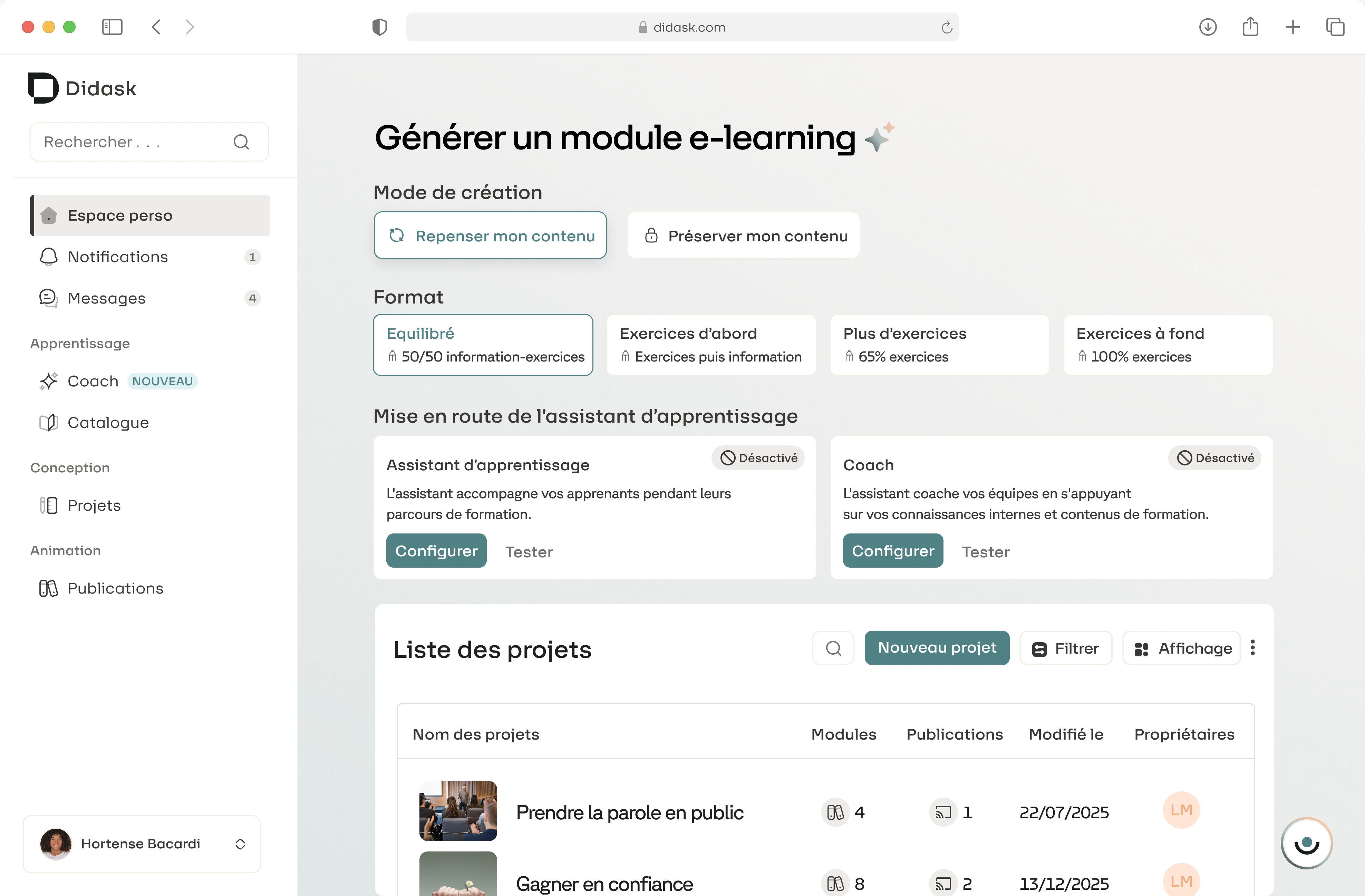

Comment nous avons mené notre étude d'impact

Notre objectif était simple : mesurer l'impact réel de différents formats pédagogiques sur trois dimensions clés.

- La satisfaction des apprenants

- L'augmentation perçue des compétences (ce que les apprenants pensent avoir appris)

- L'augmentation réelle des compétences (ce qu'ils sont effectivement capables de faire)

Pour cela, nous avons comparé trois groupes d'apprenants suivant le même contenu sur l'inclusion et la diversité en entreprise, mais dans trois formats différents.

Groupe 1 - Le LMS classique : un cours existant sur un LMS concurrent représentatif du marché. Design agréable, contenus bien présentés, mais peu d'exercices engageants, feedbacks limités, et informations peu hiérarchisées sans mise en situation concrète.

Groupe 2 - Le format descendant : une vidéo reprenant exactement le même contenu, sans aucune interaction. Le format le plus passif possible.

Groupe 3 - Le format Didask : le même contenu, mais restructuré selon nos partis pris pédagogiques. Exercices fréquents avec feedback immédiat, prise en compte des biais cognitifs les plus courants, mises en situation avec feedbacks personnalisés.

.webp)

Les résultats détaillés de cette étude feront l'objet d'un article dédié à paraître prochainement. Nous ne dévoilerons donc pas ici les chiffres complets sur les performances de chaque groupe (mais on a entendu dire que Didask amènerait notamment à de meilleurs résultats de mémorisation).

Ce qui nous intéresse aujourd'hui, ce sont les enseignements transversaux que cette étude nous a apportés sur la manière dont les adultes apprennent réellement. Trois découvertes contre-intuitives qui remettent en question les indicateurs habituellement utilisés pour mesurer l'efficacité d'une formation.

Enseignement n°1 - La satisfaction ne prédit pas l'apprentissage

En tant que professionnels de la formation, nous avons l'œil exercé. Nous repérons immédiatement un contenu vieillot et descendant versus un format dynamique et interactif. Nous plaçons nos attentes haut.

Mais voilà ce que les données nous ont appris : pourvu que le sujet soit un minimum attractif et la présentation correcte, même les formats les plus basiques peuvent sembler satisfaisants aux apprenants.

Dans notre étude, les trois groupes affichaient une satisfaction moyenne autour de 4/5. Qu'ils aient suivi une simple vidéo, un cours classique ou un parcours Didask interactif, peu importe : la différence n'était pas statistiquement significative (F(2, 57) = 2.407, p = 0.099, pour les amateurs de statistiques).

Plus troublant encore : cette satisfaction était totalement décorrélée des performances mesurées. Les corrélations oscillaient entre 0.11 et 0.18 selon les mesures, soit non statistiquement significatives.

Concrètement ? Un apprenant pouvait adorer sa formation (la recommander, prendre plaisir à la suivre, ne jamais avoir envie d'abandonner) tout en étant incapable d'appliquer ce qu'il venait d'apprendre.

Le lien avec les sciences cognitives

Ce phénomène s'explique notamment par la fluidité cognitive : quand l'information nous paraît facile à traiter (vidéo agréable, slides bien conçues), notre cerveau interprète cette facilité comme un signe de compréhension.

L'implication pour les responsables formation

La satisfaction d'un cours n'est pas un indicateur suffisant du fait que les apprenants seront capables de mettre en œuvre ce qu'ils ont vu. Arrêtons de nous fier uniquement aux smileys ou étoiles de fin de formation pour valider l'efficacité d'un dispositif.

Enseignement n°2 - Nous sommes de piètres juges de notre propre apprentissage

Deuxième claque pédagogique : non seulement les apprenants peuvent être satisfaits sans avoir appris, mais en plus, ils pensent avoir énormément progressé alors que ce n'est pas le cas.

Dans notre étude, les participants jugeaient l'amélioration de leurs compétences comme élevée. La majorité des réponses se situaient entre 4 et 5/5 pour les trois groupes. Ils étaient convaincus d'être désormais capables de repérer les entreprises inclusives et d'identifier les bonnes pratiques.

Sauf que leurs performances mesurées racontaient une tout autre histoire. Elles étaient en réalité assez basses, bien en deçà de ce qu'ils pensaient maîtriser.

Et le pire ? Penser avoir beaucoup appris n'était pas du tout prédicteur des performances réelles. Les corrélations tournaient autour de 0.17, statistiquement non significatives.

Un apprenant pouvait se sentir ultra compétent après sa formation... et échouer lamentablement à mobiliser ces compétences face à une situation concrète.

.webp)

Le lien avec les sciences cognitives

Bienvenue dans le monde de l'illusion de compétence et de l'effet Dunning-Kruger. Plus nous sommes novices sur un sujet, moins nous sommes capables d'évaluer notre propre niveau. Nous manquons précisément des compétences métacognitives nécessaires pour juger de notre maîtrise. Résultat : nous surestimons systématiquement ce que nous venons d'apprendre.

L'implication pour les responsables formation

Mesurer la montée en compétences déclarative est en réalité peu informatif de la réelle montée en compétences. Les auto-évaluations en fin de parcours ("Pensez-vous être capable de...") ne valent pas grand-chose. Il faut tester les apprenants en situation, avec des exercices qui révèlent ce qu'ils savent vraiment faire.

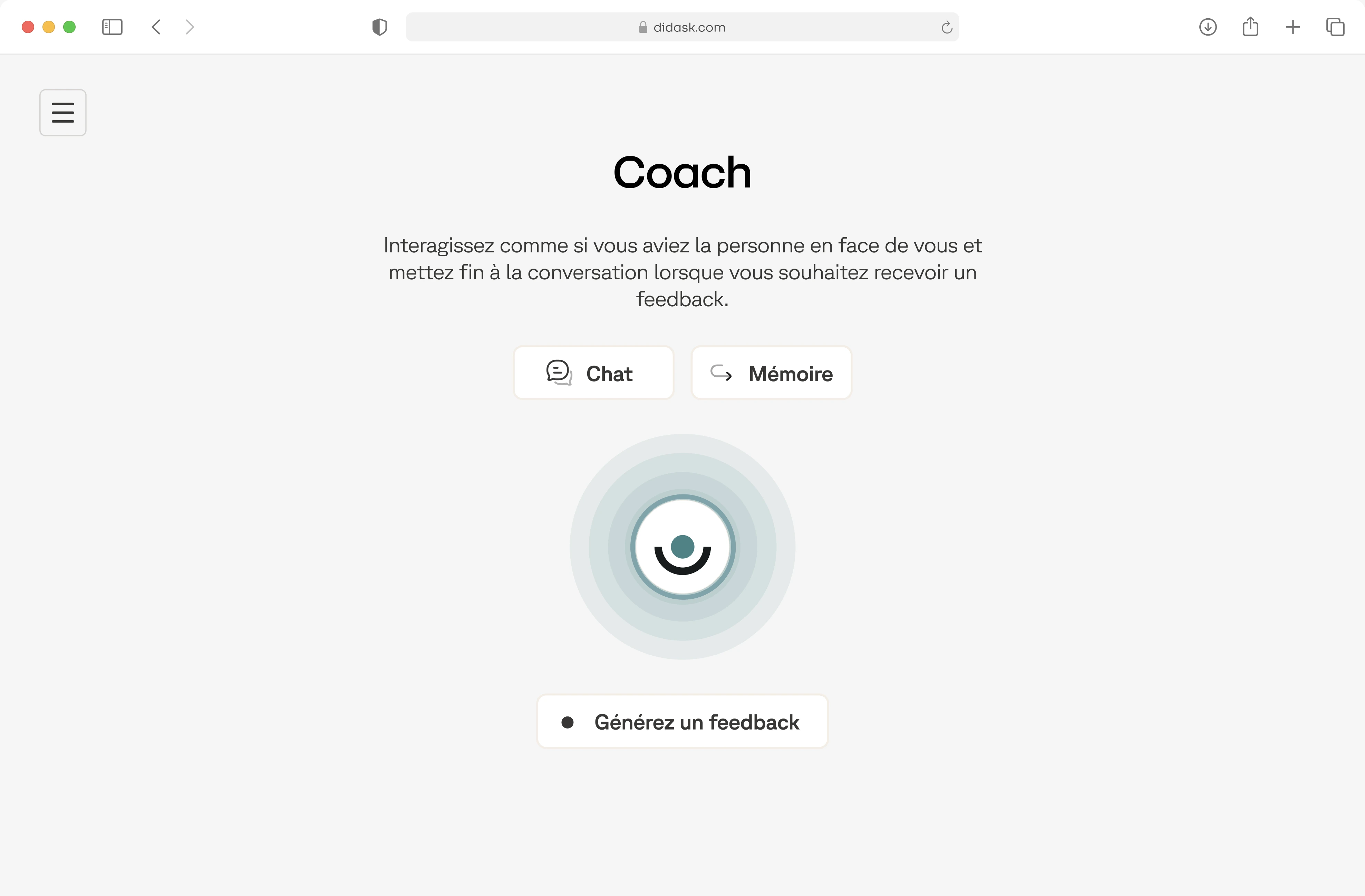

Enseignement n°3 - Sans incitation forte, même les apprenants motivés restent en surface

Troisième découverte, la plus surprenante : les apprenants, même motivés, ont tendance à traiter l'information de manière superficielle.

Dans notre groupe Didask, nous avons analysé en détail les réponses à une activité de mise en situation. Les apprenants devaient repérer des points d'amélioration dans une annonce d'emploi pour la rendre plus inclusive.

Spontanément, les réponses restaient très générales. "Il y a du vocabulaire genré", "L'annonce manque d'inclusivité", sans plus de précision.

C'est uniquement lorsque le système posait des questions de relance ciblées que les apprenants approfondissaient leur analyse. Par exemple : "Vous avez indiqué la présence de vocabulaire trop genré, sur quelle partie de l'annonce basez-vous votre réponse et quelle conséquence cela peut-il avoir sur les potentiels candidats ?"

Face à cette relance, les apprenants détaillaient alors leur raisonnement, citaient des passages précis, expliquaient les mécanismes en jeu.

On pourrait interpréter ces réponses superficielles comme un manque de motivation global. Mais l'analyse des logs et des interactions montre le contraire. Le temps passé sur les différents contenus était cohérent avec ce qui était attendu (pas de survol rapide). Les apprenants répondaient même aux questions facultatives.

.webp)

Le lien avec les sciences cognitives

Ce phénomène s'explique par le modèle des niveaux de traitement de Craik et Lockhart, et plus récemment par la taxonomie ICAP (Interactive, Constructive, Active, Passive). Notre cerveau privilégie naturellement l'économie cognitive : traiter l'information au niveau minimum suffisant pour avancer. Sans incitation explicite à manipuler activement les concepts, nous restons en mode "passif" ou au mieux "actif", sans atteindre le niveau "constructif" nécessaire à un apprentissage durable.

L'implication pour les responsables formation

Sans format forçant une analyse poussée et une manipulation des informations présentées, les apprenants risquent de rester sur une maîtrise superficielle des concepts. Le simple fait de poser des questions ne suffit pas. Il faut des dispositifs qui obligent à réfléchir, justifier, appliquer, corriger.

Ce qu'un LMS doit vraiment permettre pour générer de la montée en compétences

Ces trois enseignements convergent vers une même conclusion : un bon LMS ne se juge pas uniquement à son design ou à la satisfaction qu'il génère, mais à sa capacité à forcer l'engagement cognitif profond.

Concrètement, voici ce qu'une plateforme d'apprentissage devrait permettre pour garantir une réelle montée en compétences.

1. Tester régulièrement avec feedback immédiat pour améliorer la métacognition des apprenants. Puisqu'ils sont de mauvais juges de leur propre progression, il faut leur fournir des occasions concrètes de vérifier ce qu'ils maîtrisent vraiment. Le feedback devient alors un outil d'auto-évaluation réaliste.

2. Proposer des formats qui guident l'apprenant vers une manipulation profonde de l'information. Pas uniquement des QCM à choix multiples ou des questions fermées. Des exercices qui obligent à analyser, justifier, argumenter, avec des relances qui poussent à approfondir.

3. Confronter les apprenants aux erreurs qu'ils feraient sur le terrain, pas seulement vérifier leur compréhension théorique. Les mises en situation doivent être suffisamment réalistes pour révéler les fausses croyances et les raccourcis mentaux qui posent problème en contexte réel.

C'est exactement ce que nous avons conçu chez Didask : un LMS et un outil auteur qui intègrent ces principes dans chaque grain pédagogique. Pas par idéologie, mais parce que les données nous montrent que c'est ce qui fonctionne.

.webp)

.webp)

.png)